即刻App年轻人的同好社区

下载

做SEO很厉害的人不可能去公司打工

基本都自己搞了n多独立站"财务自由"了

而且公司讲究的是投产比,

一个一般水平的人优化几个月SEO没毛线用 还浪费团队时间和决策成本,不如SEM来的直接效率

基本都自己搞了n多独立站"财务自由"了

而且公司讲究的是投产比,

一个一般水平的人优化几个月SEO没毛线用 还浪费团队时间和决策成本,不如SEM来的直接效率

1 00

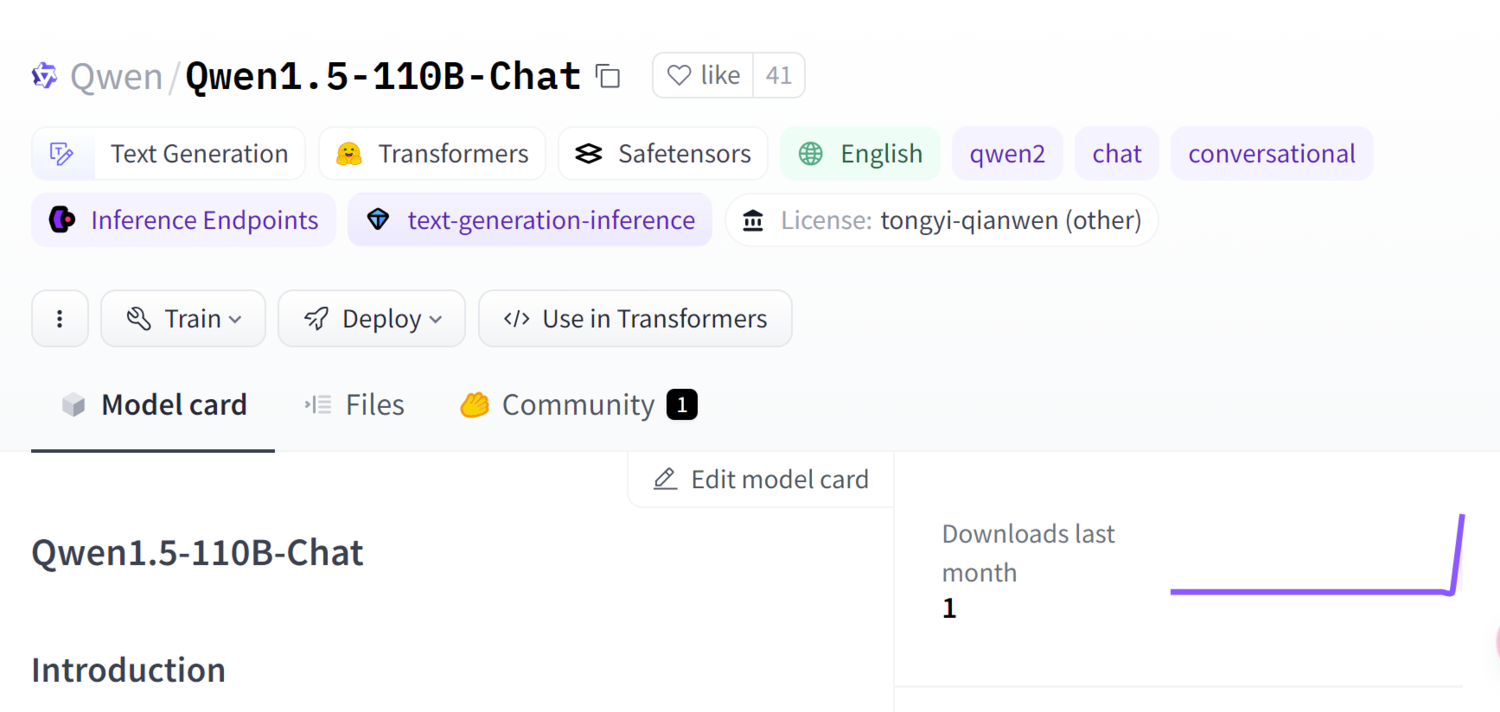

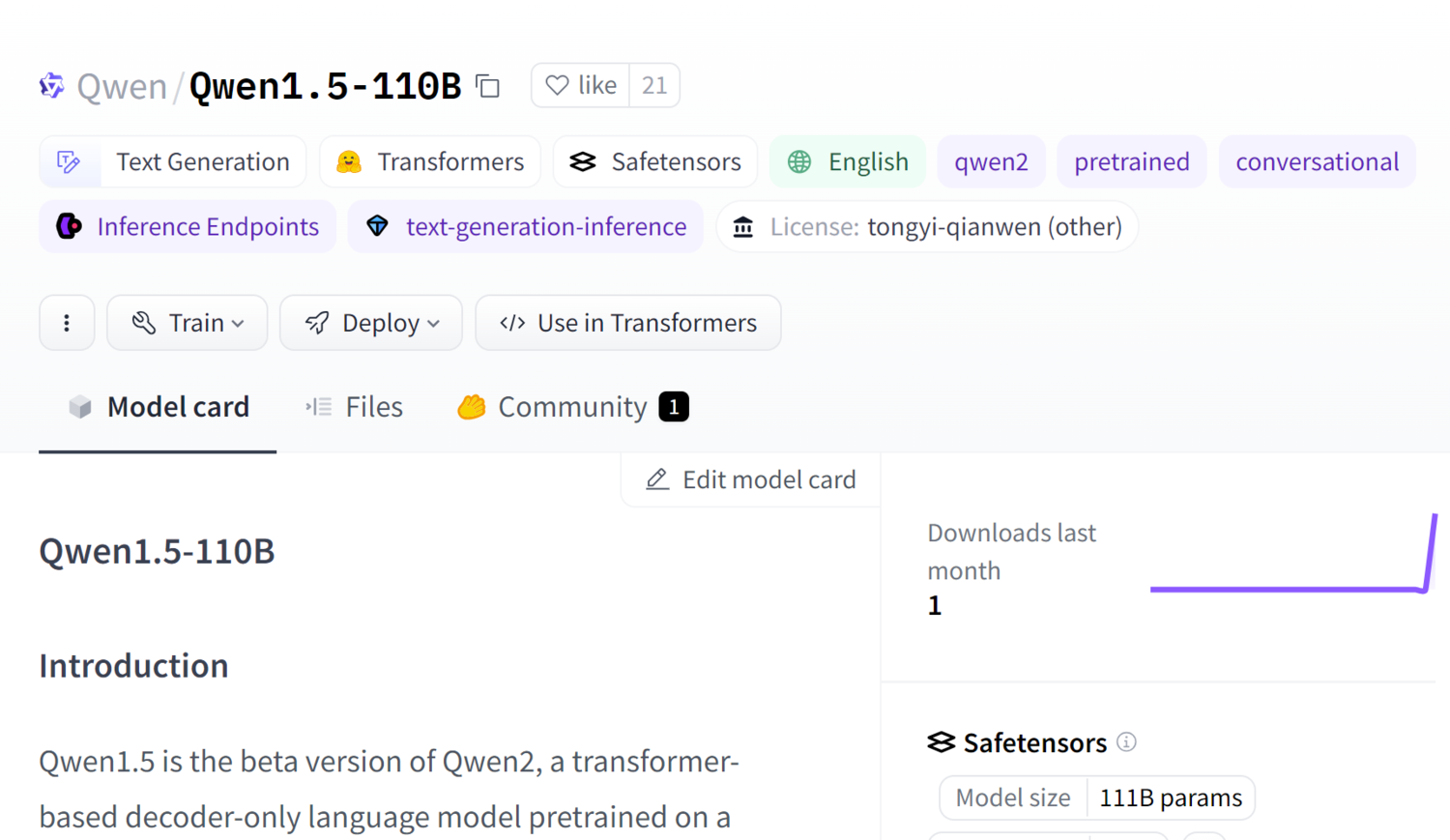

阿里巴巴发布了首个千亿参数的大模型 Qwen1.5-110B

此前它发布了 0.5B、1.8B、4B、7B、14B 、32B和 72B 不同规模参数的版本

目前算是中文领域开源最强模型

1.5系列模型支持 32K tokens 的上下文长度

huggingface.co

huggingface.co-Chat

qwenlm.github.io

qwenlm.github.io

www.solidot.org

此前它发布了 0.5B、1.8B、4B、7B、14B 、32B和 72B 不同规模参数的版本

目前算是中文领域开源最强模型

1.5系列模型支持 32K tokens 的上下文长度

huggingface.co

huggingface.co-Chat

qwenlm.github.io

qwenlm.github.io

www.solidot.org

2 08

现在多轮对话都是要由用户主动发起,有没有办法让大模型主动沟通呢?

可以有两种方法

1.通过代码程序主动发起让大模型提问沟通

2.prompt里面也可以带一个让他回答后再说一句问题,然后正则抽取下就是大模型主动提问了

可以有两种方法

1.通过代码程序主动发起让大模型提问沟通

2.prompt里面也可以带一个让他回答后再说一句问题,然后正则抽取下就是大模型主动提问了

1 31

Llama-3官网链接:llama.meta.com

Github 地址:github.com

开源地址:huggingface.co

英伟达在线体验Llama-3:www.nvidia.com

划重点:

1. Meta周四推出两款较小版本的开源大模型Llama-3,同时发布新版本AI助手。

2. Meta为AI助手设立独立网站Meta.ai,将把它整合到Facebook、Instagram、WhatsApp和Messenger应用。

3. 两款较小的Llama-3版本分别在80亿个参数和700亿个参数下训练,MMLU得分达到82分。

4. Meta计划在今年推出正式版Llama-3,目前用4000亿个参数进行训练,MMLU得分达到85分。

5. 与Llama-2相比,Llama-3使用了15Ttokens的训练数据,在推理、数学、代码生成、指令跟踪等能力获得大幅度提升

Github 地址:github.com

开源地址:huggingface.co

英伟达在线体验Llama-3:www.nvidia.com

划重点:

1. Meta周四推出两款较小版本的开源大模型Llama-3,同时发布新版本AI助手。

2. Meta为AI助手设立独立网站Meta.ai,将把它整合到Facebook、Instagram、WhatsApp和Messenger应用。

3. 两款较小的Llama-3版本分别在80亿个参数和700亿个参数下训练,MMLU得分达到82分。

4. Meta计划在今年推出正式版Llama-3,目前用4000亿个参数进行训练,MMLU得分达到85分。

5. 与Llama-2相比,Llama-3使用了15Ttokens的训练数据,在推理、数学、代码生成、指令跟踪等能力获得大幅度提升

1 00

最近微调大模型

真的是数据决定了模型质量

只要有几条错误数据模型在这任务上就救不回来了

传统深度学习模型鲁棒性比较强,5%错误率都能接受

大模型5%错误率这模型就废了,1%错误率幻觉就很严重了,任务输出也不稳定

真的是数据决定了模型质量

只要有几条错误数据模型在这任务上就救不回来了

传统深度学习模型鲁棒性比较强,5%错误率都能接受

大模型5%错误率这模型就废了,1%错误率幻觉就很严重了,任务输出也不稳定

7 11