即刻App年轻人的同好社区

下载

StableDiffusion最强大的插件ContorlNet今天更新了1.1版本,这是一个很大的更新,旧模型增加了很多数据进行了重新训练,还新增了几个模型,目前模型总数达到了14个,新增了4个模型。可能会给SD带来新的玩法。下面是具体的更新内容:

- 更改了模型命名规则:从 ControlNet 1.1 开始,我们开始使用标准 ControlNet 命名规则 (SCNNR) 来命名所有模型。我们希望此命名规则可以改善用户体验。

- 现有的 Depth、Normal、Canny、Scribble、MLSD、HED 模型在增加数据后进行了更多的训练效果有不同程度的提升。

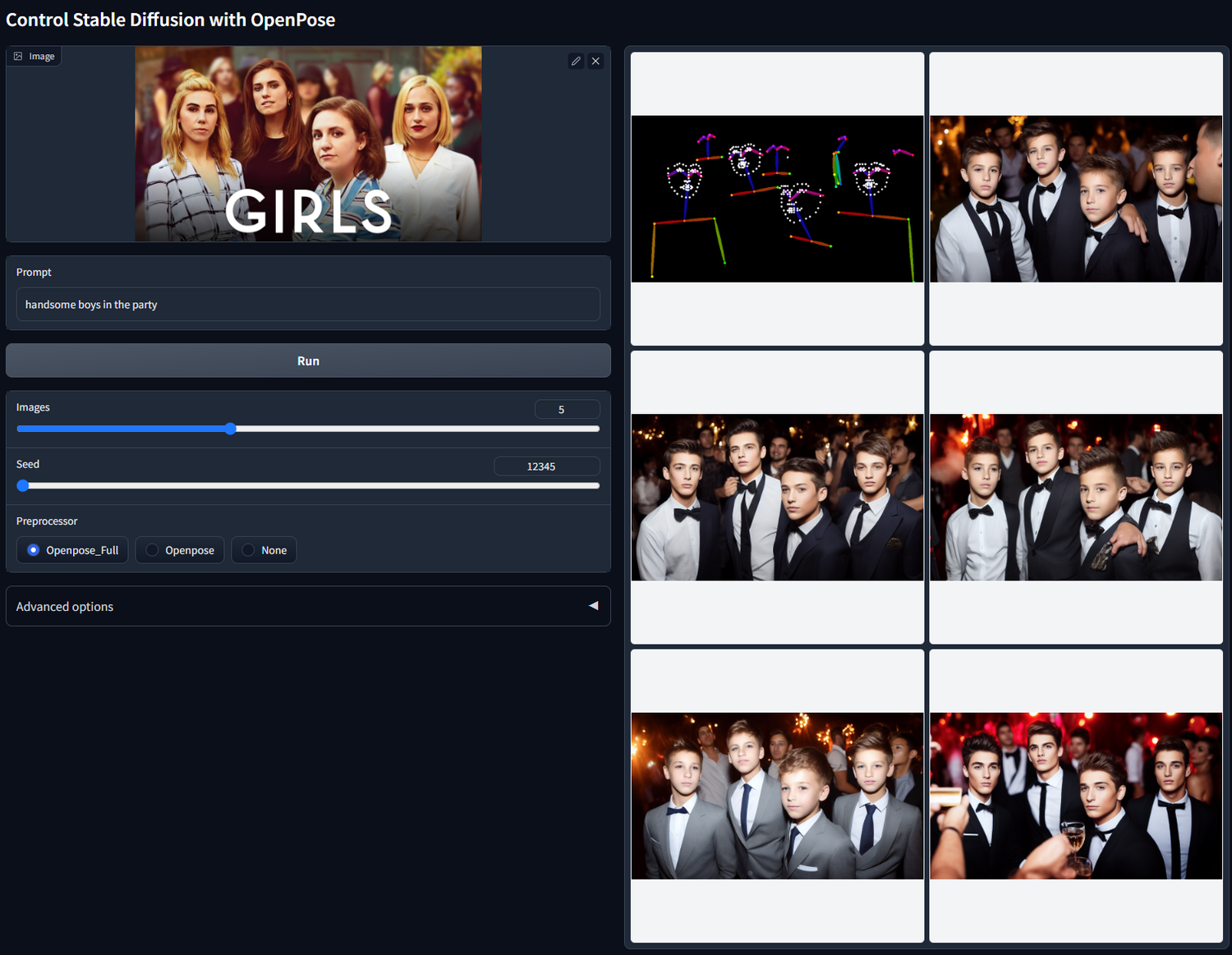

- Openpose增加了对面部和手部的支持,可以选择只针对身体生效,还是对身体+面部+手部生效。

- 线稿专用模型支持手绘线稿和自动识别两种模式

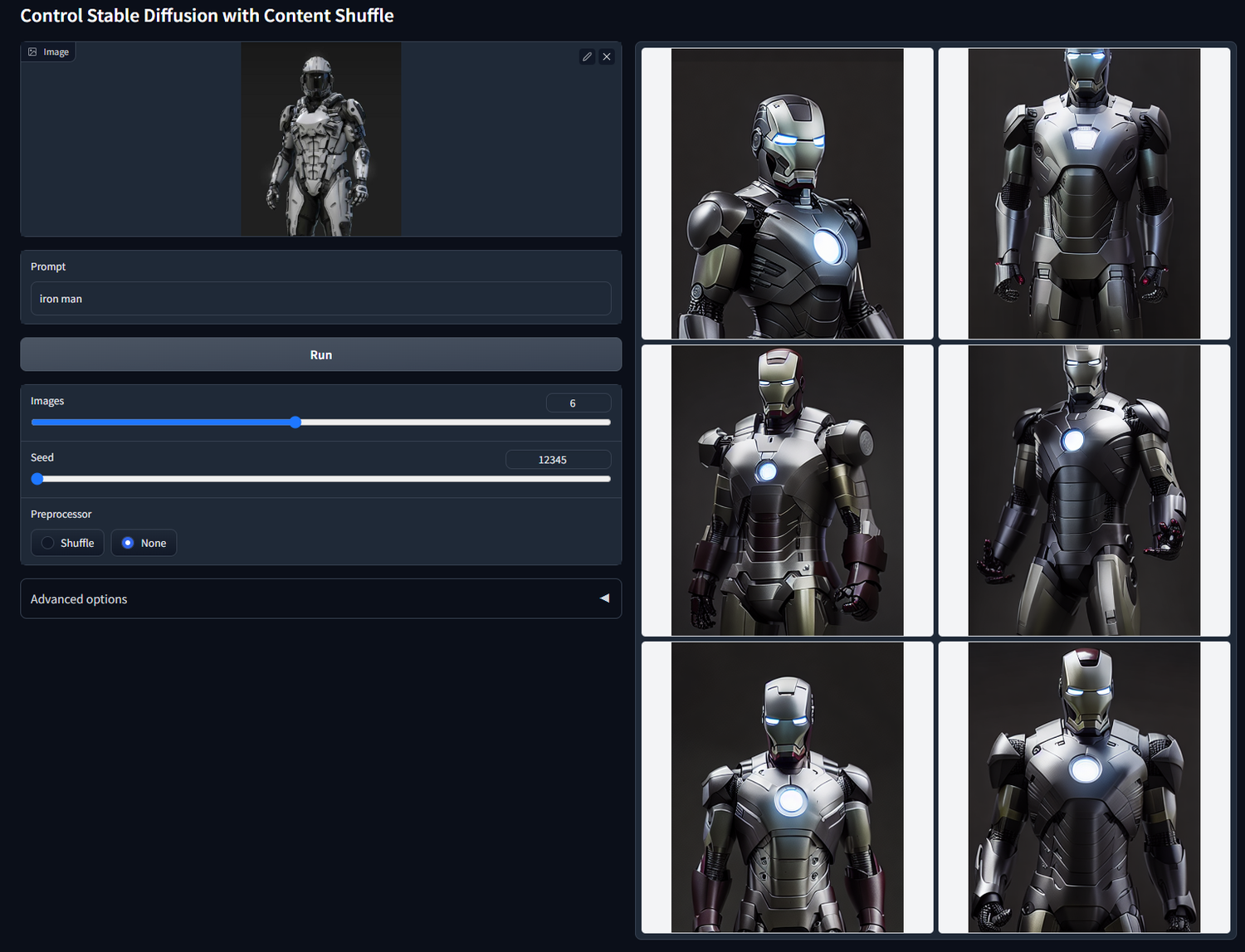

- 新增Content Shuffle模型:能够重新组织图像。使用随机流程将图像混洗,然后利用控制StableDiffusion来重新组合图像。

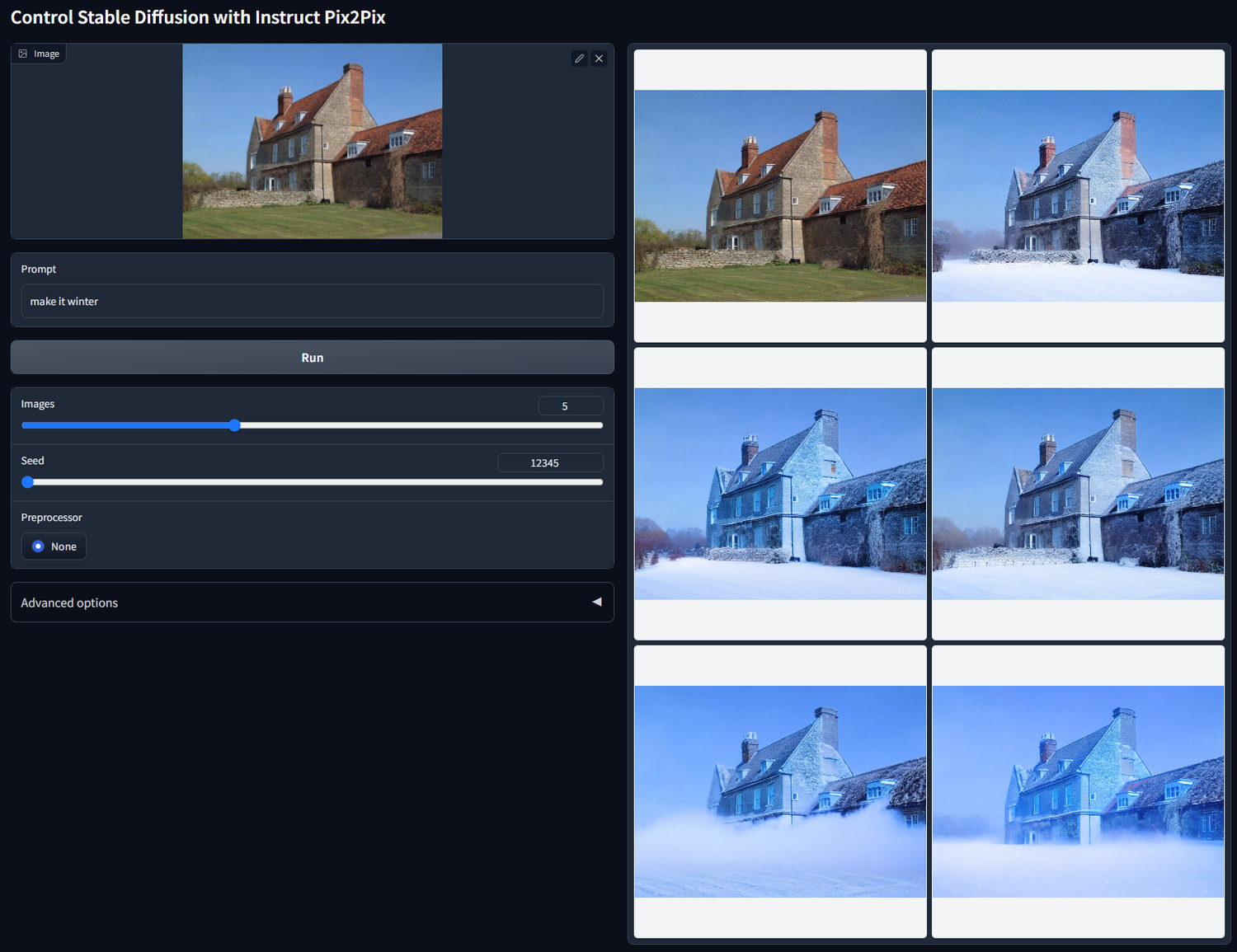

- 新增Instruct Pix2Pix模型:可以理解为原有的Pix2Pix模型,他们做了一些优化,使其更易用。

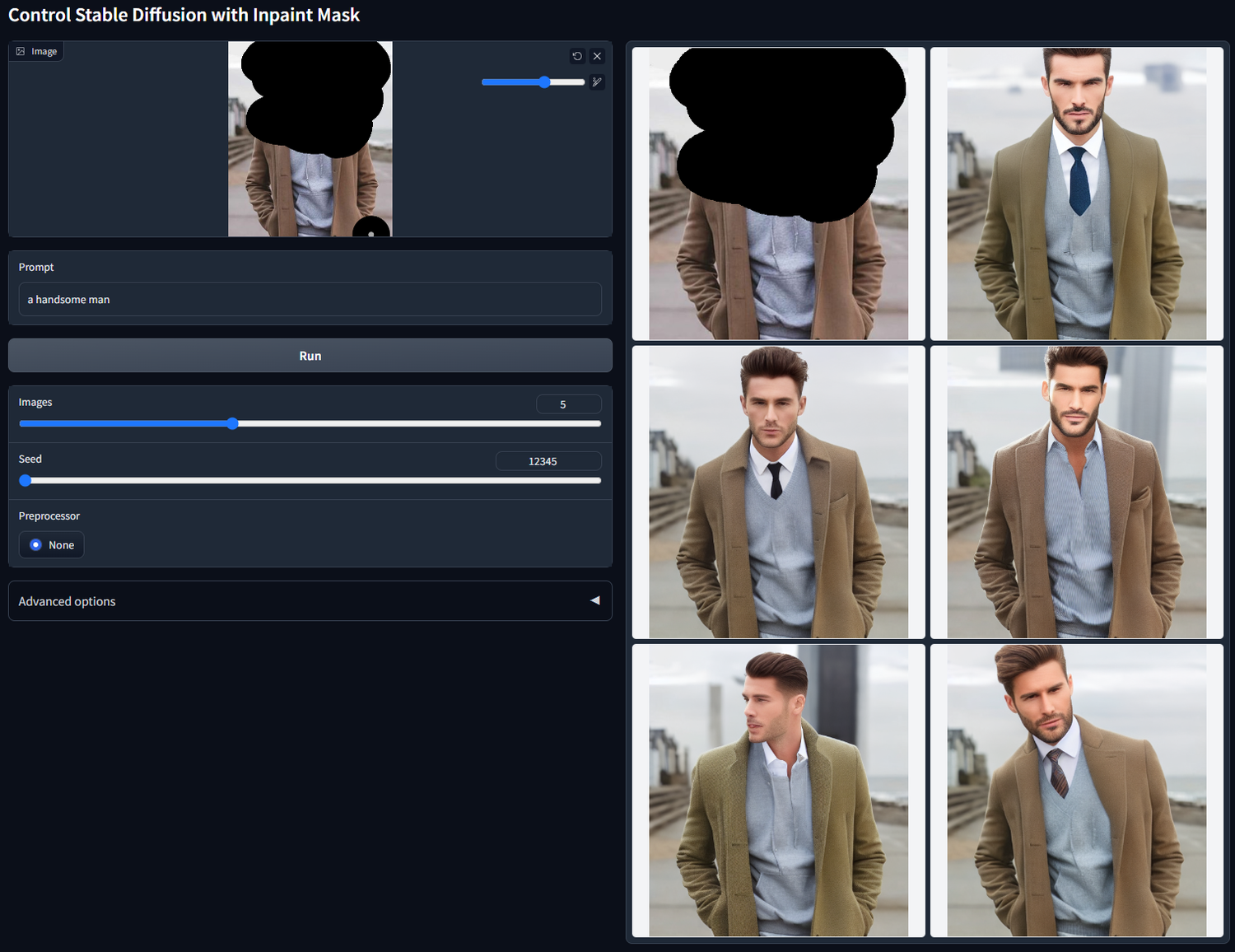

- 新增Inpaint模型:主要功能是对图像进行修复,比如涂抹的区域,此外这个模型可能也会用来解决生成视频的连续性问题。

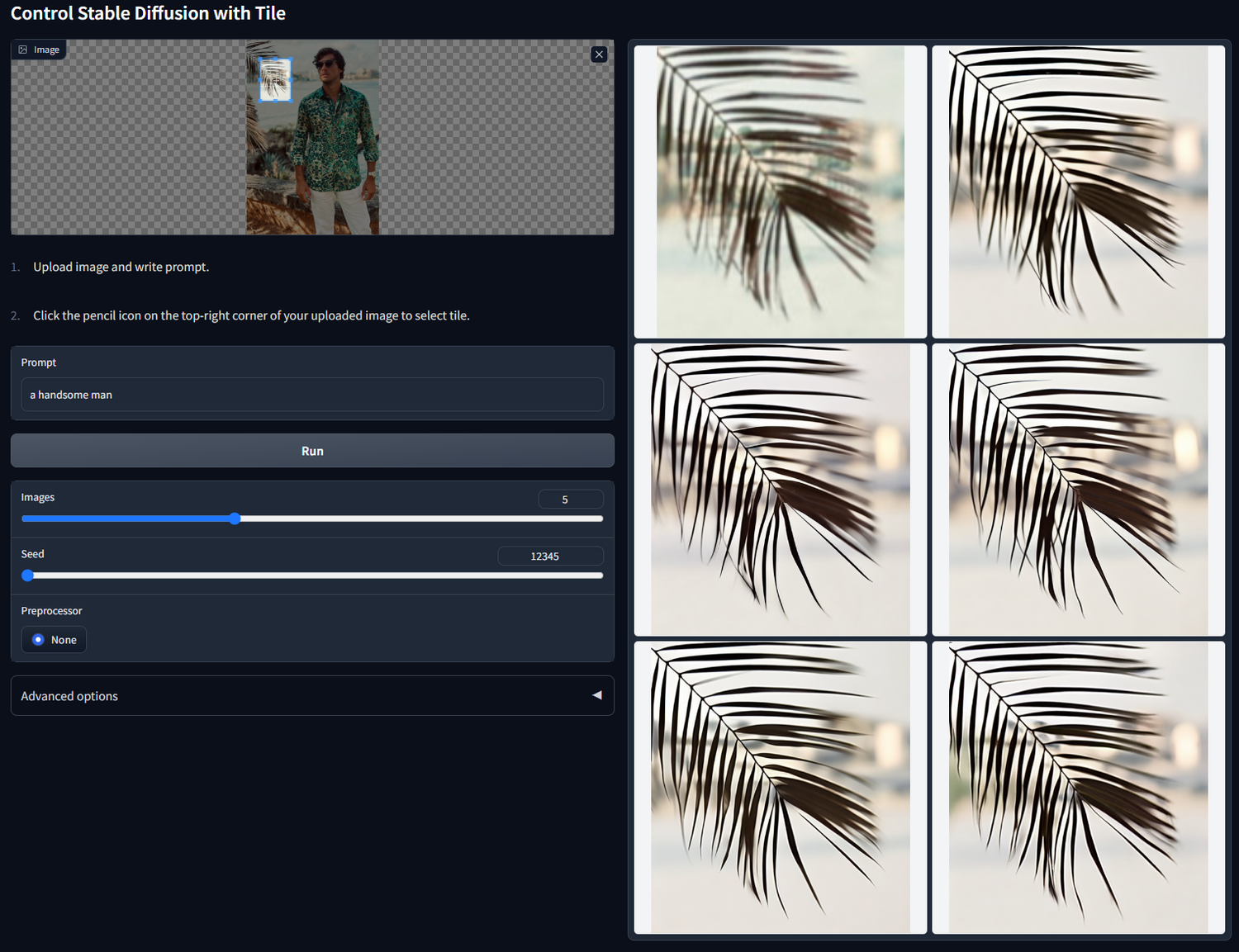

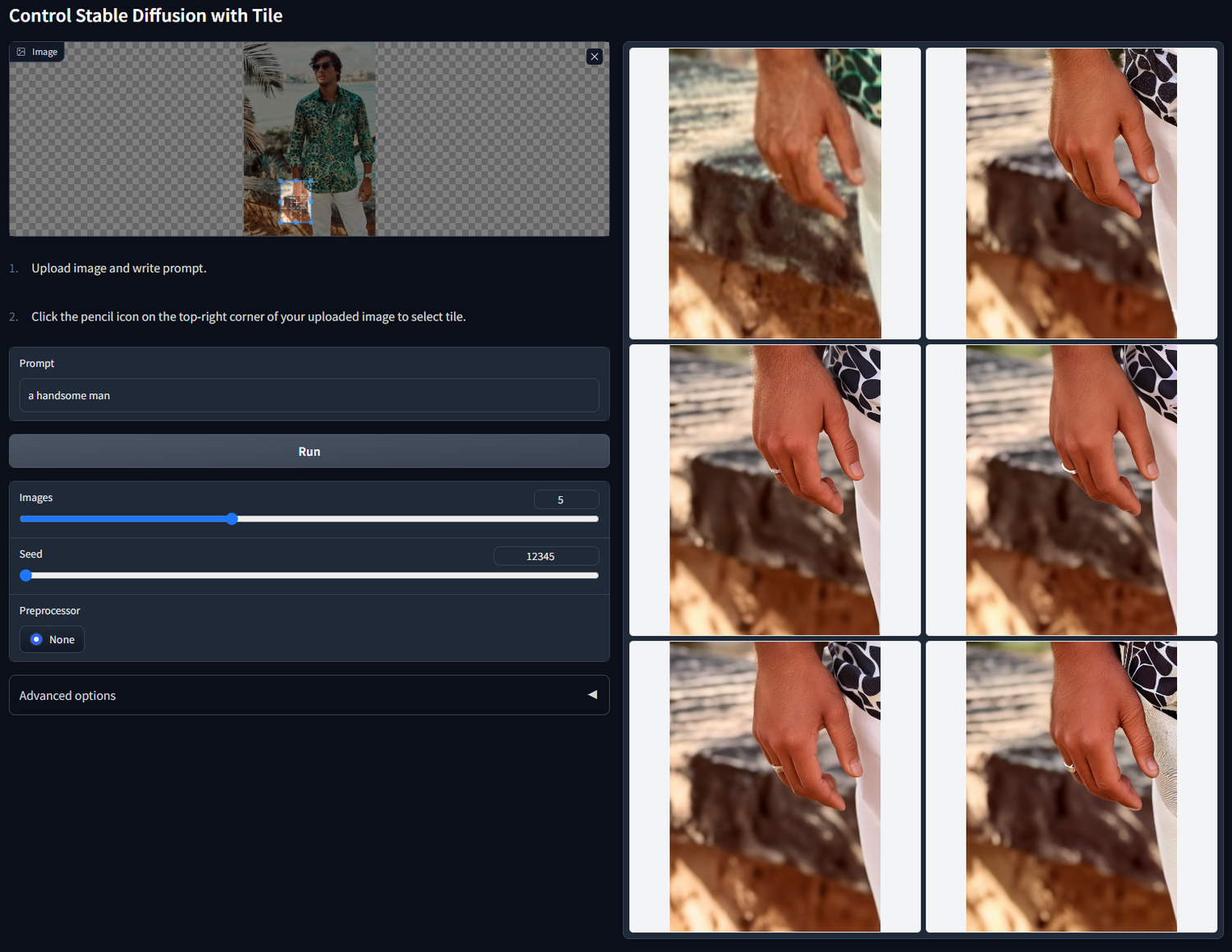

- 新增Tile模型(未完成):尝试解决利用Tile控制SD时提示将始终影响每个区域的问题。对于给定的区域,它识别区域内部的内容,并增加了该识别出的语义的影响,如果内容不匹配,则还减少了全局提示的影响。

目前不建议立刻更新1.1,等其他大佬适配完试试再说,另外小道消息ContorlNet插件的作者最近入职了谷歌。

Github链接:github.com

Huggingface模型下载链接:huggingface.co

- 更改了模型命名规则:从 ControlNet 1.1 开始,我们开始使用标准 ControlNet 命名规则 (SCNNR) 来命名所有模型。我们希望此命名规则可以改善用户体验。

- 现有的 Depth、Normal、Canny、Scribble、MLSD、HED 模型在增加数据后进行了更多的训练效果有不同程度的提升。

- Openpose增加了对面部和手部的支持,可以选择只针对身体生效,还是对身体+面部+手部生效。

- 线稿专用模型支持手绘线稿和自动识别两种模式

- 新增Content Shuffle模型:能够重新组织图像。使用随机流程将图像混洗,然后利用控制StableDiffusion来重新组合图像。

- 新增Instruct Pix2Pix模型:可以理解为原有的Pix2Pix模型,他们做了一些优化,使其更易用。

- 新增Inpaint模型:主要功能是对图像进行修复,比如涂抹的区域,此外这个模型可能也会用来解决生成视频的连续性问题。

- 新增Tile模型(未完成):尝试解决利用Tile控制SD时提示将始终影响每个区域的问题。对于给定的区域,它识别区域内部的内容,并增加了该识别出的语义的影响,如果内容不匹配,则还减少了全局提示的影响。

目前不建议立刻更新1.1,等其他大佬适配完试试再说,另外小道消息ContorlNet插件的作者最近入职了谷歌。

Github链接:github.com

Huggingface模型下载链接:huggingface.co

60 528

来自圈子

AI探索站

112420人已经加入